|

用于大家评估是否采用华为云mindspore的实验要求说明 用于大家评估是否采用华为云mindspore的实验要求说明 |

|

|

华为云、作业、实验成绩查询 华为云、作业、实验成绩查询 |

|

|

加分ex6实验指导:基于Mindspore-Ascend的llama7b模型推理与微调实验 加分ex6实验指导:基于Mindspore-Ascend的llama7b模型推理与微调实验 |

|

|

| 成绩组成&考试范围 |

QQ 群test 提示词汇总/课前复习重点 QQ 群test 提示词汇总/课前复习重点 |

| 算法 |

模型假设 |

损失函数 |

优化方法 |

| 朴素贝叶斯 |

特征条件独立(给定类别下特征独立) |

对数似然损失(最大似然估计) |

极大似然估计(或EM算法处理缺失值) |

| SVM |

数据线性可分(或通过核函数映射到高维可分),最大化分类间隔 |

Hinge Loss + L2正则化项 |

拉格朗日对偶 + SMO(序列最小优化) |

| 集成学习 |

- 随机森林:特征子集独立性

- GBDT:残差逐步拟合 |

- 随机森林:基尼系数/信息增益

- GBDT:自定义损失(如平方损失、对数损失) |

- 随机森林:Bagging

- GBDT:梯度下降(加法模型) |

| PCA |

数据在低维线性子空间上方差最大 |

重构误差最小化(或协方差矩阵特征值最大化) |

特征值分解(或SVD) |

| K-Means |

数据呈球形分布,簇内紧密 |

样本到簇心的平方距离和(SSE) |

EM算法(迭代更新簇心与样本分配) |

| 逻辑回归 |

数据线性可分,通过sigmoid映射概率 |

交叉熵损失(对数损失) |

梯度下降(或拟牛顿法) |

| 线性回归 |

数据成线性分布 |

平方误差 |

最小二乘/随机梯度下降 |

| DNN |

多层非线性变换可拟合复杂函数 |

任务相关(如交叉熵、均方误差) |

反向传播 + 梯度下降变体(如Adam、SGD) |

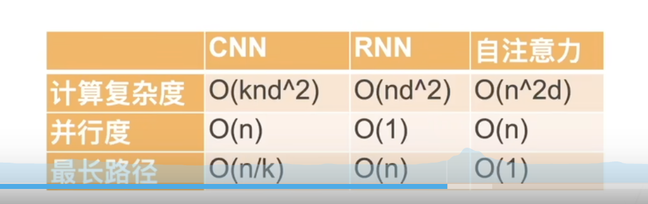

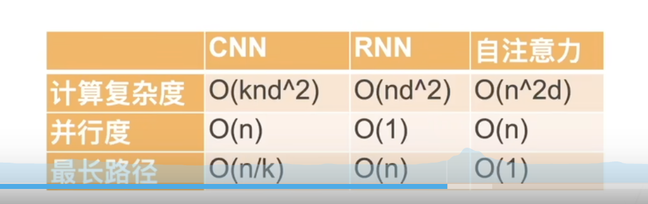

| CNN |

局部相关性、平移不变性(通过卷积核和池化) |

任务相关(如交叉熵) |

反向传播 + 梯度下降变体(如Adam) |

| RNN |

序列数据的时间依赖性(通过循环结构传递状态) |

交叉熵(序列预测任务) |

BPTT(随时间反向传播)+ 梯度截断/Adam |

| Transformer |

全局依赖关系通过自注意力机制捕获 |

交叉熵(带掩码的序列预测任务) |

Adam优化器 + 学习率预热(如Noam调度) |

- 以垃圾邮件分类为例,出一道查准率(precision).查全率(recall)的计算题。试述真正例率(TPR).假正例率(FPR)与查准率(precision).查全率(recall)之间的关系。出一道多项选择题。

- 写出绘制PR曲线的伪代码

-

- 模仿教材例题 4.1 更改数值。出计算填空题。

- 模仿教材例题 7.1 让学生利用几何方法直接求 svm最 ⼤ 间 隔 分 离 超 平面方程。多选题。

- 模仿教材例题 7.2 更改点坐标 让学生 计算对偶问题展开化简过程。出填空题。

- svm 求解分几步。出排序题。

- 出一道多项选择题,下面哪些问题是凸优化问题。

- 出一道多选题,svm 对偶问题的 KKT 条件,下面给出的哪些是正确的?给 10 个选项条件 诺干错 剩余对。

-

- 模仿教材 例题 5.2 更改数值后 出一道填空题 随机考一种属性划分 计算信息增益 ;不用让他们重复计算每一种划分。

- 算法 5.2 出一道 排序题

- 算法 5.3 出一道 排序题

- 模仿教材 例题 5.4 更改数值后 出一道填空题 随机考一种属性划分 计算Gini;不用让他们重复计算每一种划分

- 出一道 6 个选项的单选题,给定一个比较明显的数据,让学生用 ID3 生成决策树,选择正确的树。主要考察学生对决策树算法的理解,即使不计算数值,也能估算最后的决策树。

- 模仿教材 例题 8.1 更改数值后 出一道填空题 挖多个空 考一次更新权重过程即可

-

- 出一道 计算 题 考d2l教材公式6.3.2

- 已知模型网络架构 求上述模型参数量

- RNN 会考去年试卷 同类型计算题

|

|

| 参考教材&答疑方式时间 |

教材1《深度学习基础》刘远超 (暂无电子版,本书虽然涵盖教材2和3的大部份内容,但是不够详细,建议以23为主学习) 教材1《深度学习基础》刘远超 (暂无电子版,本书虽然涵盖教材2和3的大部份内容,但是不够详细,建议以23为主学习) |

《深度学习基础》刘远超 (暂无电子版) 《机器学习》周志华 《动手深度学习》李沐https://zh.d2l.ai/ |

|

教材2《动手深度学习》李沐https://zh.d2l.ai/ https://openi.pcl.ac.cn/mindspore-courses/d2l-mindspore 教材2《动手深度学习》李沐https://zh.d2l.ai/ https://openi.pcl.ac.cn/mindspore-courses/d2l-mindspore |

《深度学习基础》刘远超 (暂无电子版) 《机器学习》周志华 《动手深度学习》李沐https://zh.d2l.ai/

|

|

《动手学深度学习》的MindSpore实现 《动手学深度学习》的MindSpore实现 |

|

|

教材3 李航《统计学习方法(第2版)》 教材3 李航《统计学习方法(第2版)》 |

|

|

PythonDataScienceHandbook PythonDataScienceHandbook |

|

|

PythonDataScienceHandbook PythonDataScienceHandbook |

|

|

mindspore官方教程 mindspore官方教程 |

|

|

赵鑫等《大语言模型》 赵鑫等《大语言模型》 |

|

|

| 第1讲 机器学习概述 |

课前线上资源:1.1机器学习的引出 课前线上资源:1.1机器学习的引出 |

该视频主要讲述了机器学习的定义和基本流程,以及如何从简单的线性分类器演变为深度学习的分类器。视频还介绍了深度学习的定义、特点、来历、应用领域和模型框架。深度学习是机器学习的分支,是实现机器学习的一种重要技术手段,其模型结构一般是含有多个隐藏层的多层神经网络。视频强调了深度学习的基础知识的重要性,包括数据集的拆分、模型的性能评价等内容。

|

|

实验1Numpy考试题库 实验1Numpy考试题库 |

12 星(没有提示)考填空(去年都是从头写降低了难度),63 题中抽 40 题,每题 2分;三星题 34 题(没有提示)中抽 5 题考填空,每题 4分。三星题 34 题(没有提示)中抽 1 题考从头写的编程 10 分。总分 110 分,超过 100 分的按 100 分计。考试时间 90 分钟。 |

|

本讲ppt 本讲ppt |

|

|

| 第2讲 机器学习的预备知识 |

sklearn画PR曲线代码 sklearn画PR曲线代码 |

|

|

翻转课堂:sklearn画PR曲线(黄子睿) 翻转课堂:sklearn画PR曲线(黄子睿) |

|

|

sklearn文档向量化 sklearn文档向量化 |

|

|

翻转课堂:sklearn文档向量化(邓媚) 翻转课堂:sklearn文档向量化(邓媚) |

|

|

sklearn量纲缩放 sklearn量纲缩放 |

|

|

翻转课堂:sklearn量纲缩放(蔡诗彬) 翻转课堂:sklearn量纲缩放(蔡诗彬) |

|

|

nndl神经网络与深度学习,398页附录,复习相关数学知识 nndl神经网络与深度学习,398页附录,复习相关数学知识 |

|

|

课前完成线上内容观看:数据集及其拆分 课前完成线上内容观看:数据集及其拆分 |

本视频主要讲述了数据集及其拆分、有监督学习、验证集、机器学习算法和特征提取、模型评估等模块的相关内容。此外,还介绍了埃德康是一个开源的p发行版本,包含了多个科学包及其依赖项,以及最简单的训练集和测试集的拆分方法及流除法的不足之处,k折交叉验证相对于流出法的优势,超参数的概念,以及如何通过网格搜索和k折交叉验证来调整超参数,以优化模型性能。

|

|

04课件 04课件 |

|

|

课件 课件 |

|

|

| 第3讲 线性回归 |

课件 线性回归 课件 线性回归 |

|

|

| 第4讲 softmax 回归和 logist 回归 |

回归问题 回归问题 |

|

|

二次回归与线性回归的比较代码 二次回归与线性回归的比较代码 |

|

|

复习:课中线上资源 二次回归与线性回归的比较. 复习:课中线上资源 二次回归与线性回归的比较. |

|

|

档首页> AI开发平台ModelArts> 开发环境> CodeLab 档首页> AI开发平台ModelArts> 开发环境> CodeLab |

|

|

| 第5讲 贝叶斯分类器 |

贝叶斯课件 贝叶斯课件 |

|

|

| 第6讲 SVM |

SVM课件 SVM课件 |

|

|

| 第7讲 集成学习1 |

课前资源 信息熵 课前资源 信息熵 |

|

|

决策树课件 决策树课件 |

|

|

| 第8讲 集成学习2 |

翻转课堂 信息熵代码演示(庄晴慧) 翻转课堂 信息熵代码演示(庄晴慧) |

|

|

信息熵代码 信息熵代码 |

|

|

集成学习课件 集成学习课件 |

|

|

| 第9讲 多层感知机 1 |

09 多层感知机 1 09 多层感知机 1 |

|

|

| 第10讲 多层感知机 2 |

课中线上资源 批次标准化BN 课中线上资源 批次标准化BN |

|

|

课中资源 激活函数 dropout 课中资源 激活函数 dropout |

|

|

10 多层感知机 2 10 多层感知机 2 |

|

|

| 实验1 numpy 考试 及 熟悉 华为免费算力codelab 使用 |

档首页> AI开发平台ModelArts> 开发环境> CodeLab 档首页> AI开发平台ModelArts> 开发环境> CodeLab |

|

|

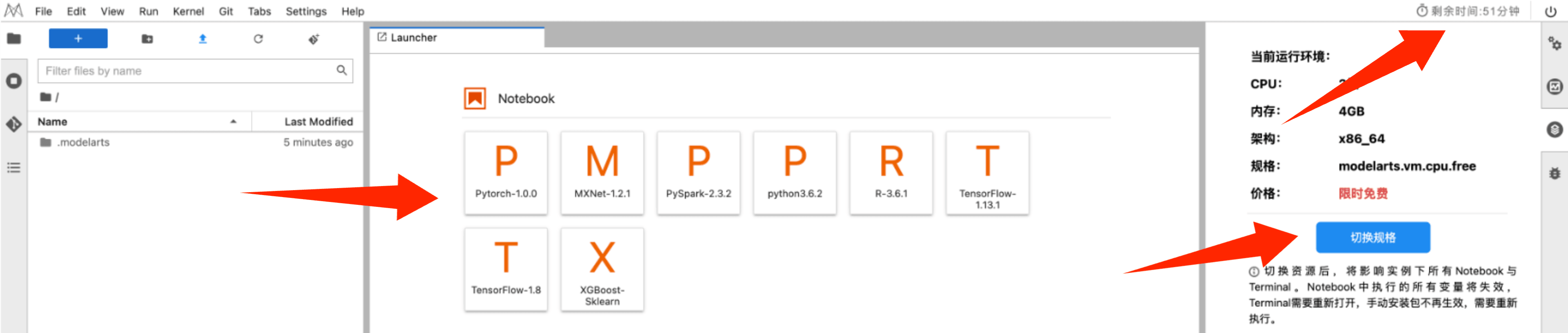

华为云modelarts 的免费算力 codelab 使用方式(更新安装 mindspore 方法) 华为云modelarts 的免费算力 codelab 使用方式(更新安装 mindspore 方法) |

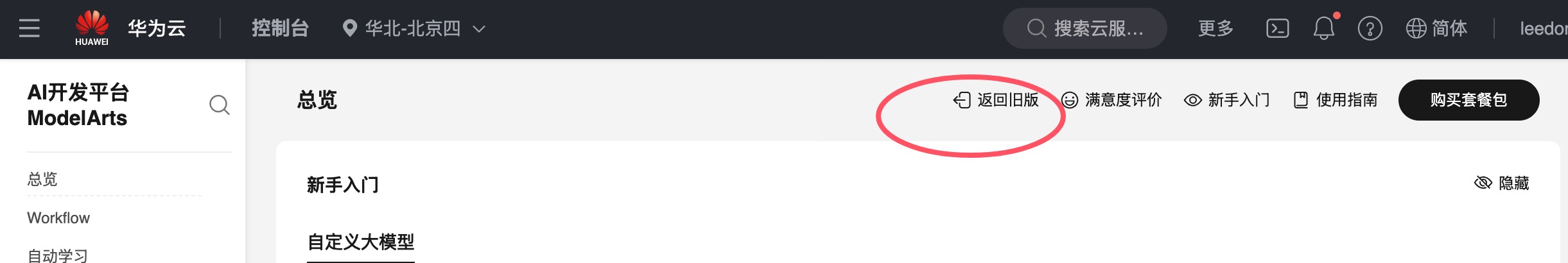

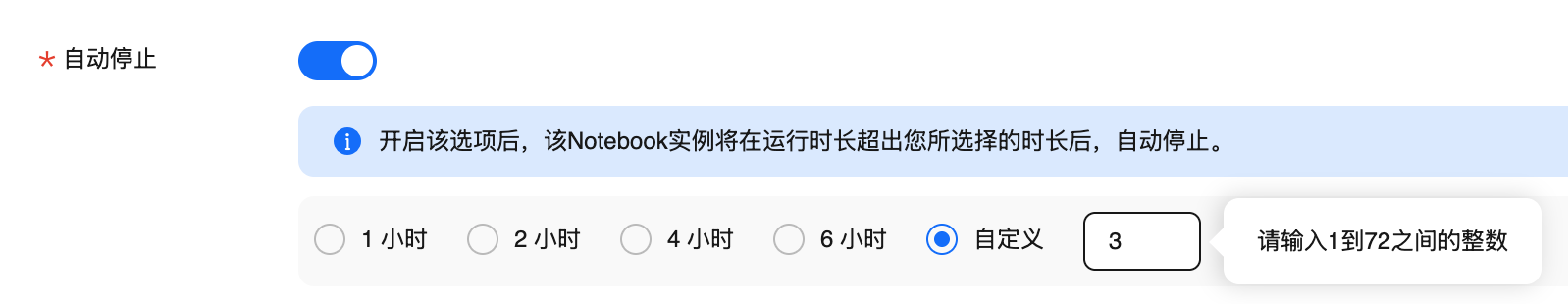

- 点击https://www.huaweicloud.com/product/modelarts.html 并登录

- 登录后,在页面中央大字 AI开发平台ModelArts,点击 控制台。

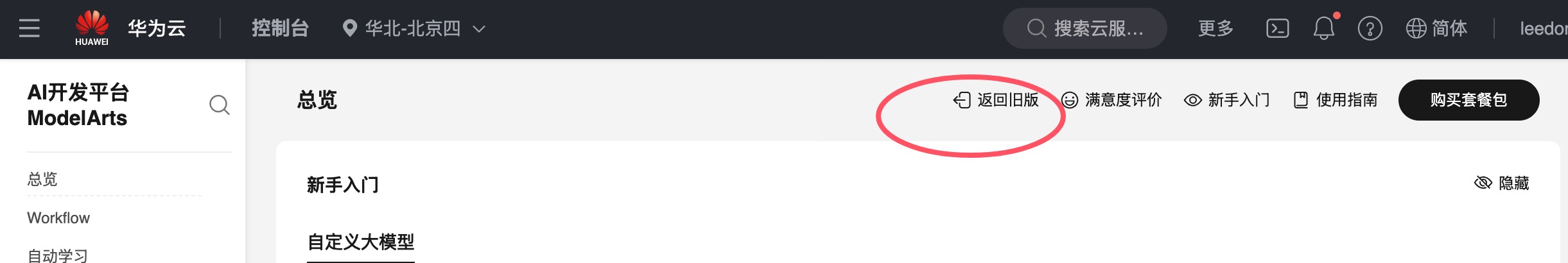

- 在控制台页面右侧点击 返回旧版

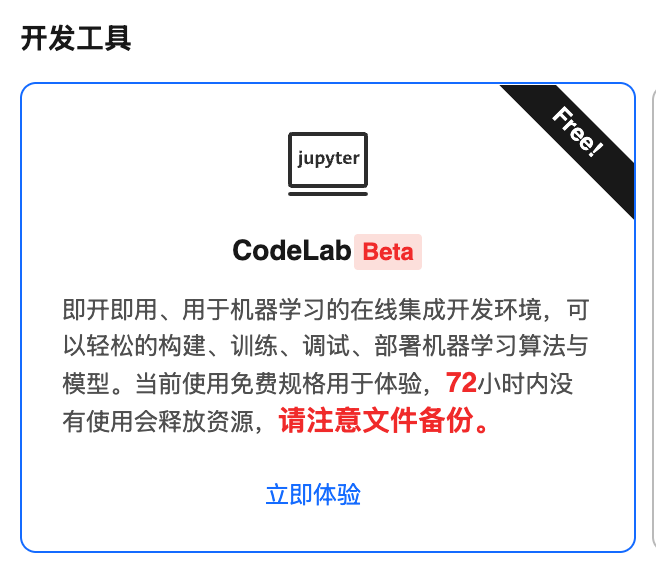

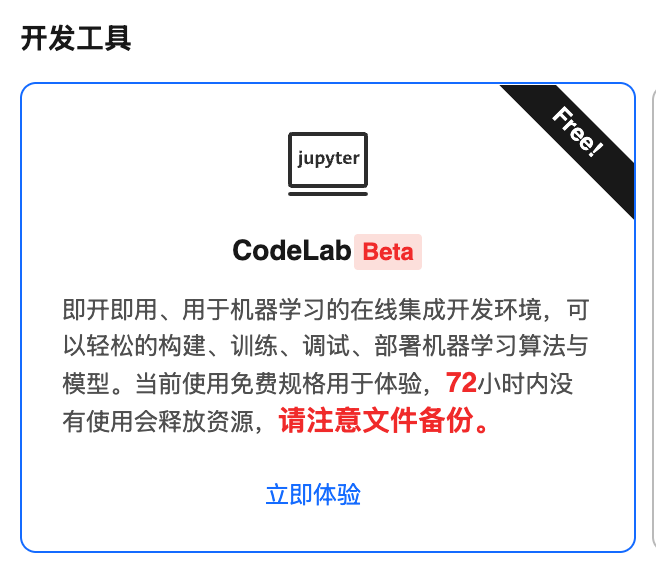

4.最后在旧版页面点击 codelab beta Free,“当前使用免费实例规格用于体验,72小时内没有使用,会释放资源,请注意文件备份。”

5. 通过点击剩余时间更新,可以在快要断开时将时间延长到 1 小时,因此这种免费模式,适合使用者一直在电脑前的简单任务。

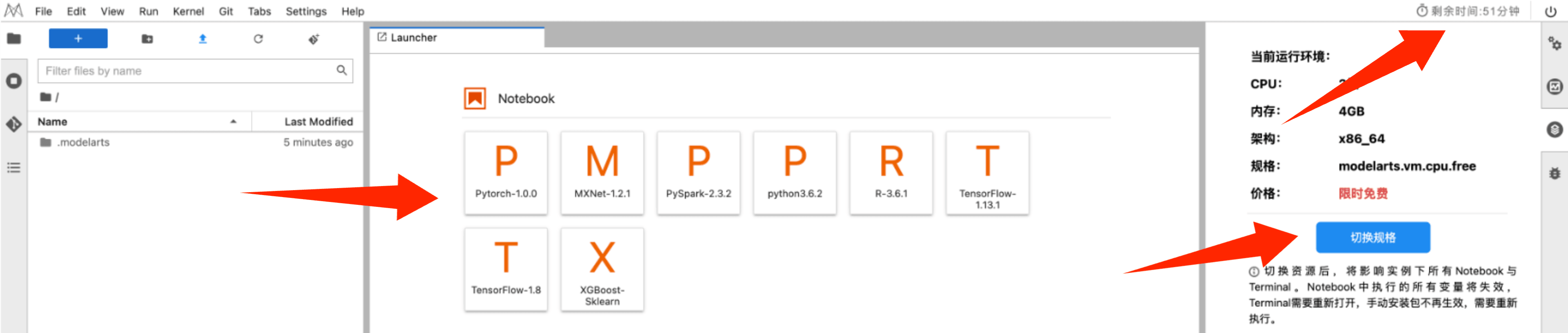

6. 通过点击切换规格可以使用免费的 CPU 或 GPU 实例。

===================================================

7. 更新 python 3.9 和 mindspore 2.2.14 kernel(可选 如果是比较新的 代码运行需要这部)

在 ipynb 添加如下代码块

%%capture captured_output

!/home/ma-user/anaconda3/bin/conda create -n python-3.9.0 python=3.9.0 -y --override-channels --channel https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main

!/home/ma-user/anaconda3/envs/python-3.9.0/bin/pip install ipykernel

import json

import os

data = {

"display_name": "python-3.9.0",

"env": {

"PATH": "/home/ma-user/anaconda3/envs/python-3.9.0/bin:/home/ma-user/anaconda3/envs/python-3.7.10/bin:/modelarts/authoring/notebook-conda/bin:/opt/conda/bin:/usr/local/nvidia/bin:/usr/local/cuda/bin:/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/home/ma-user/modelarts/ma-cli/bin:/home/ma-user/modelarts/ma-cli/bin"

},

"language": "python",

"argv": [

"/home/ma-user/anaconda3/envs/python-3.9.0/bin/python",

"-m",

"ipykernel",

"-f",

"{connection_file}"

]

}

if not os.path.exists("/home/ma-user/anaconda3/share/jupyter/kernels/python-3.9.0/"):

os.mkdir("/home/ma-user/anaconda3/share/jupyter/kernels/python-3.9.0/")

with open('/home/ma-user/anaconda3/share/jupyter/kernels/python-3.9.0/kernel.json', 'w') as f:

json.dump(data, f, indent=4)

|

|

modelarts帮助文档 modelarts帮助文档 |

|

|

| 第11讲 深度学习计算 |

课前线上资源 感知机 课前线上资源 感知机 |

|

|

课中资源 正向反向传播代码示例 课中资源 正向反向传播代码示例 |

|

|

翻转课堂 mindspore自动微分代码演示 翻转课堂 mindspore自动微分代码演示 |

https://www.mindspore.cn/tutorials/zh-CN/r1.10/beginner/autograd.html

|

|

mindspore自动微分 代码 mindspore自动微分 代码 |

|

|

mindspore 训练DNN分类网络代码示例 mindspore 训练DNN分类网络代码示例 |

|

|

11 课件 DNN BP 11 课件 DNN BP |

|

|

一些 AI/ML 学习中重要却被忽视的问题 一些 AI/ML 学习中重要却被忽视的问题 |

|

|

| 第12讲 卷积神经网络 |

mindspore lenet代码 mindspore lenet代码 |

|

|

课前资源 卷积与卷积神经网络 课前资源 卷积与卷积神经网络 |

|

|

课件12-1 卷积和池化 课件12-1 卷积和池化 |

|

|

课件12-2 LeNet AlexNet VGG NiN 课件12-2 LeNet AlexNet VGG NiN |

|

|

| 第13讲 卷积神经网络 2 |

课件13-1 Inception ResNet 课件13-1 Inception ResNet |

|

|

| 第 14-1讲 循环神经网络 1 |

RNN Seq2Seq 示例代码 RNN Seq2Seq 示例代码 |

|

|

| 第14-2讲 循环神经网络 2 |

翻转课堂 RNN实现情感分类(李谕锋) 翻转课堂 RNN实现情感分类(李谕锋) |

|

|

课前资源 循环神经网络 课前资源 循环神经网络 |

|

|

课件14 RNN 课件14 RNN |

|

|

| 实验2 逻辑回归+xgboost(test02) |

版本控制(Git) 版本控制(Git) |

|

|

实验 2 gitee 地址 按下方说明 fork 实验 2 gitee 地址 按下方说明 fork |

https://gitee.com/gdutcv/mlex02

实验课内完成 所有且通过老师/助教审查问答(每人一次代码重写机会,审查问答改进代码和报告任意次),删除任意 5 行左右代码,60 秒内可以重写,满分 100 分。120 秒内重写,95 分。超过 120 秒,按未能重写计算,88 分。课后 完成所有 85 分。未完成所有项目按比例扣分。 |

|

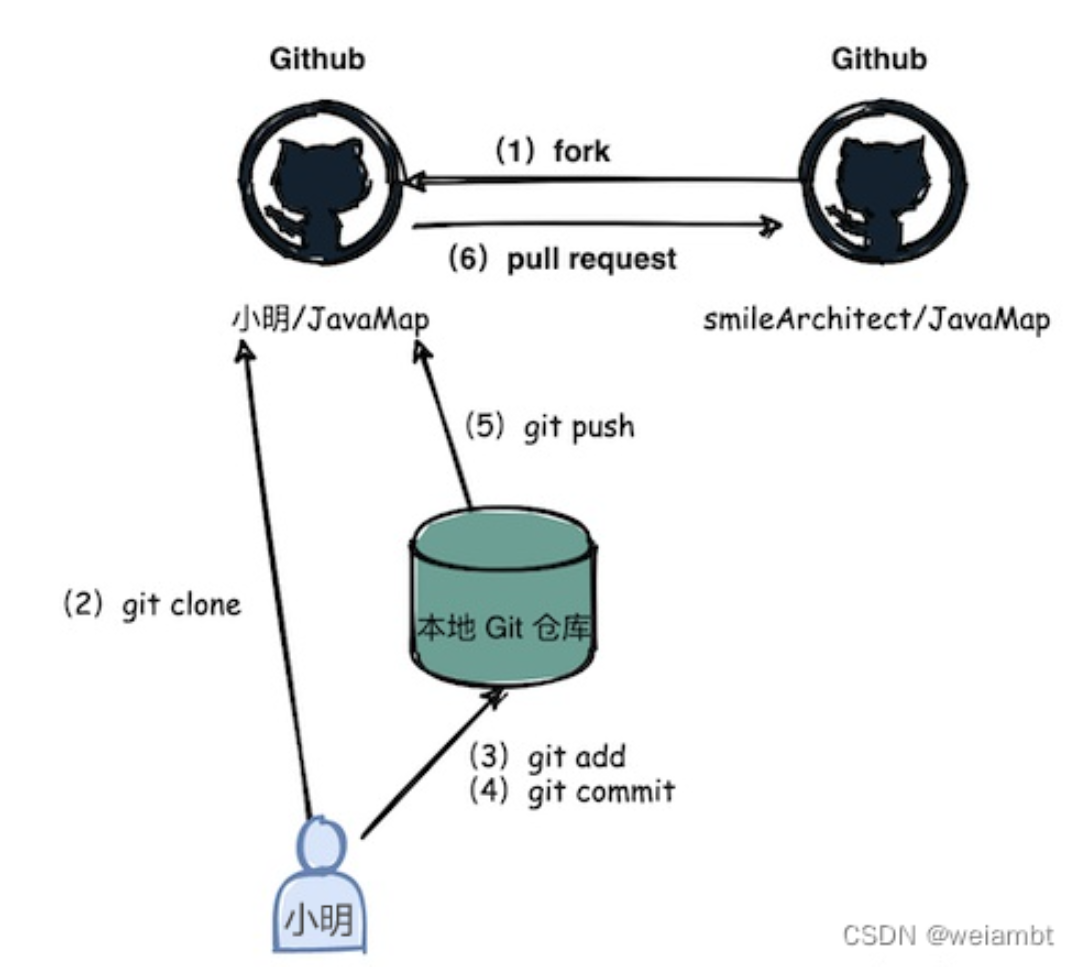

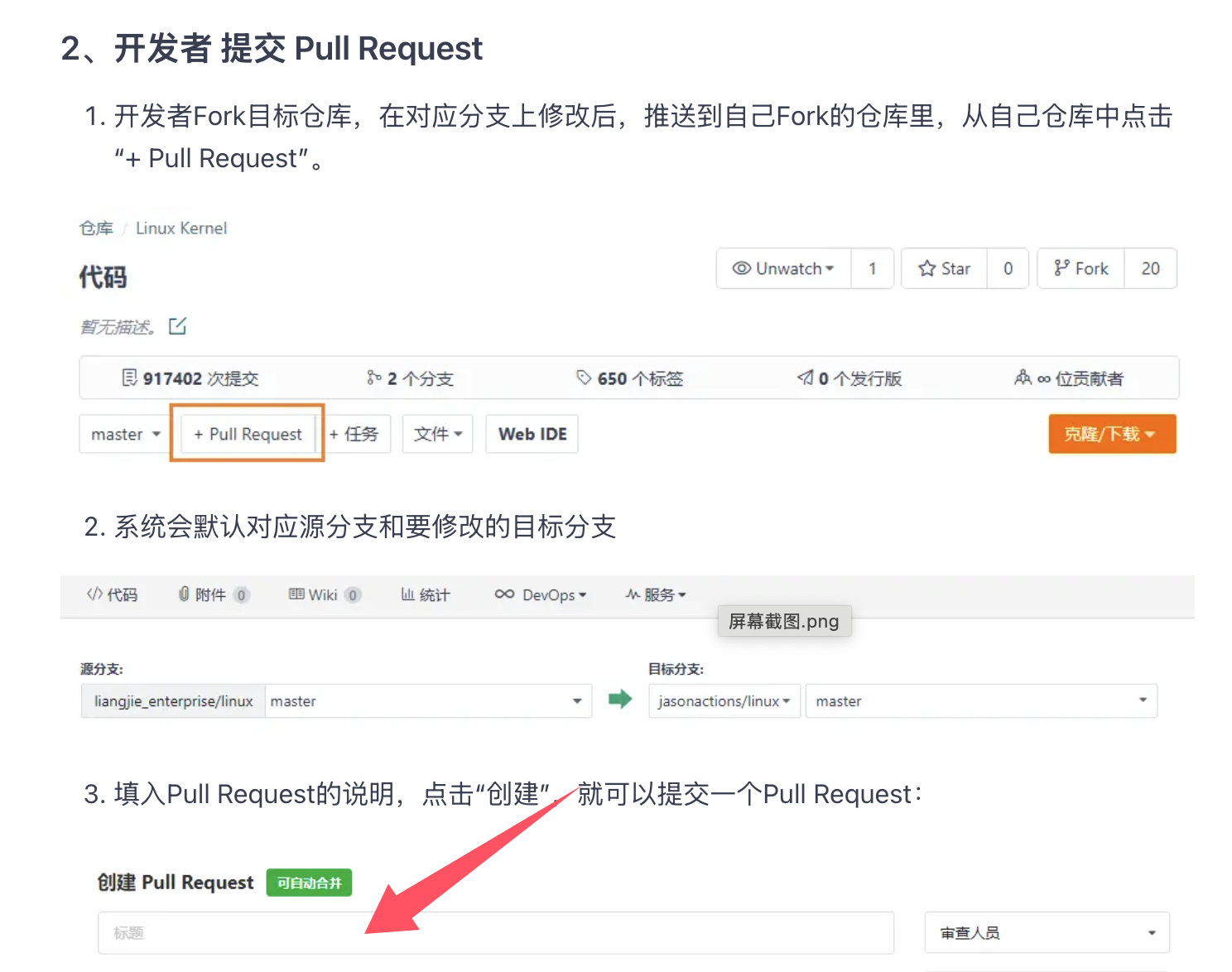

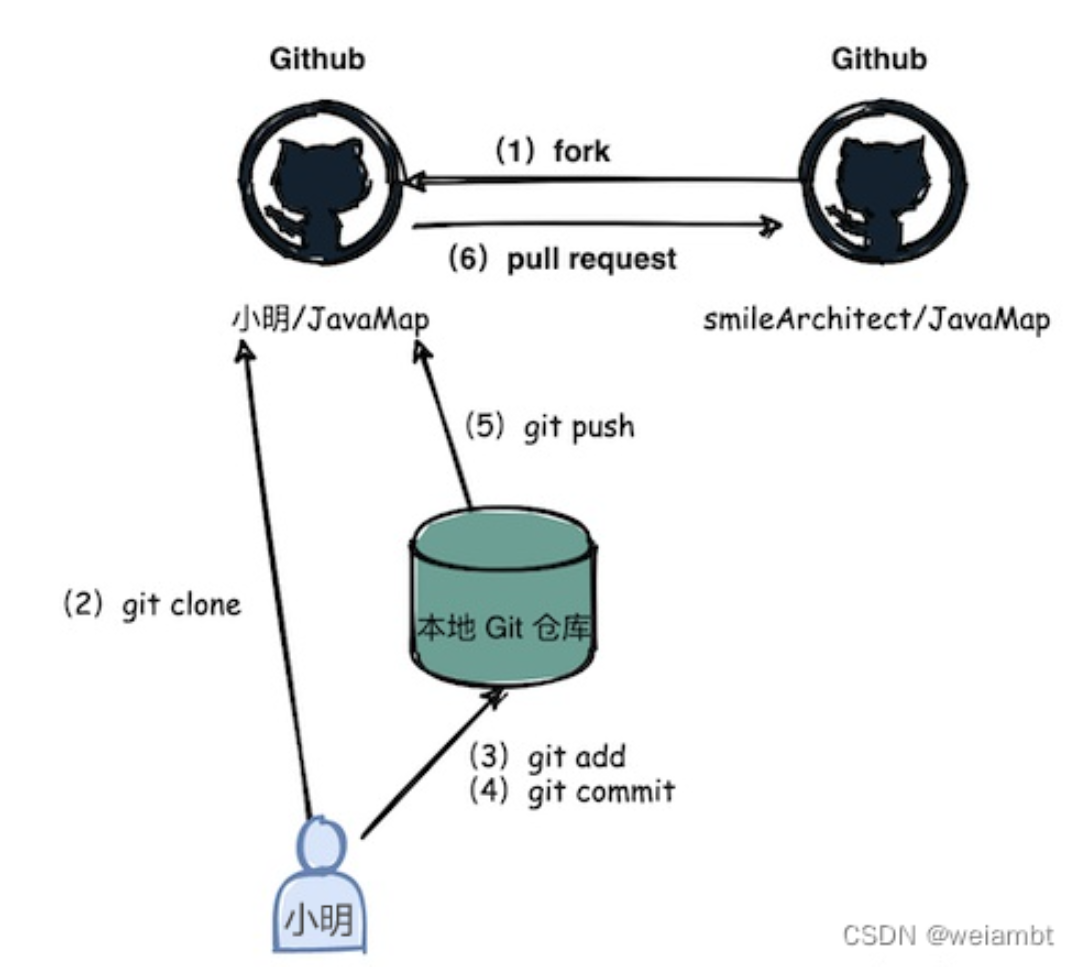

使用 codelab 从 gitee 获取ex 完成 ex 后 提交PR 使用 codelab 从 gitee 获取ex 完成 ex 后 提交PR |

- 确保有权限:向老师确认自己已被添加到私有库的成员列表中,拥有访问权限。加入列表网址:见 qq 群 4 月 6 日 17 点55群消息

- 在老师给的该次实验网址点击 fork

3. 然后在自己 fork 后仓库获取 clone git 地址 并新建 312200xxxx 分支 (学号)

后续继续在 modelarts codelab 操作

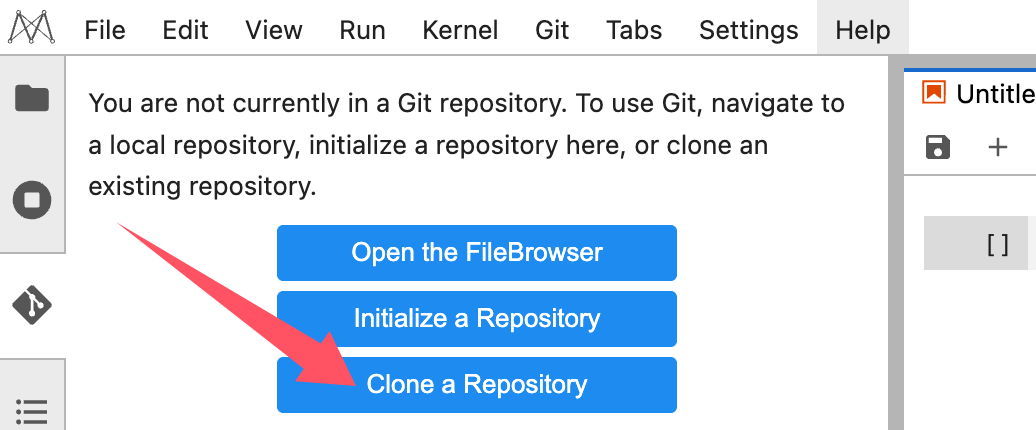

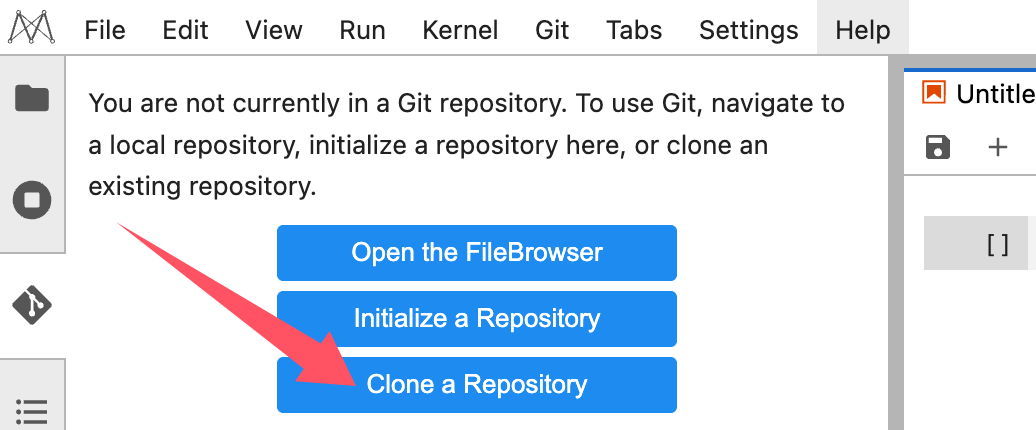

- 点击 codelab 页面左侧Clone

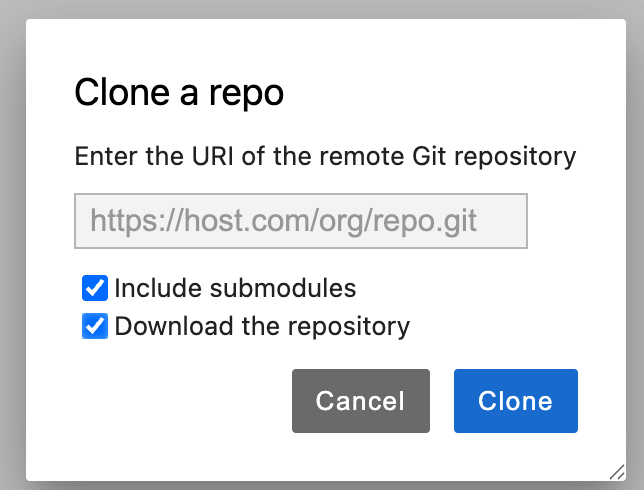

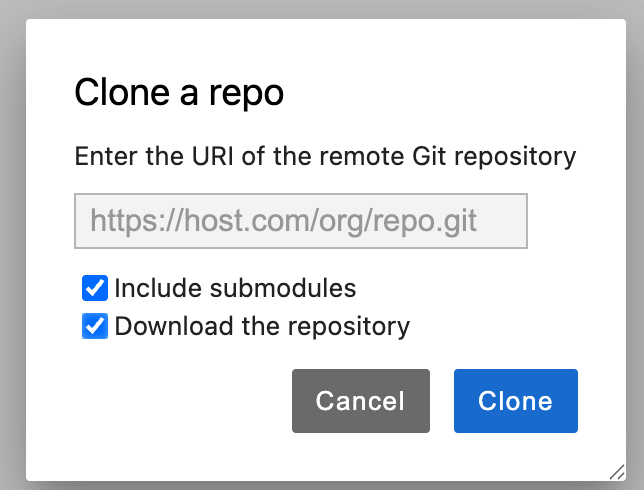

2. 将该次实验室 git 网址录入对话框 并勾选下载仓库

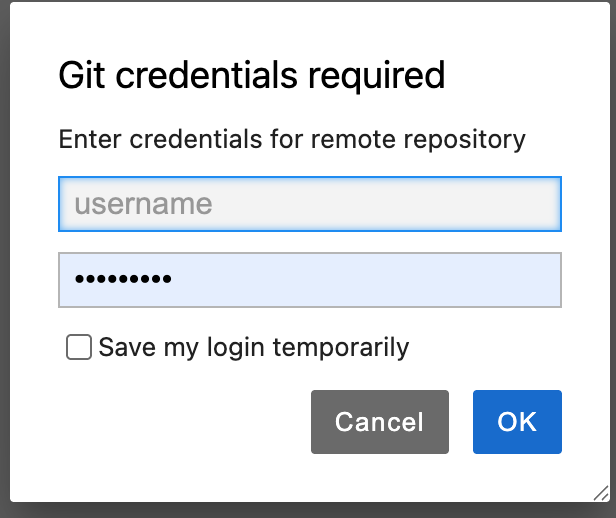

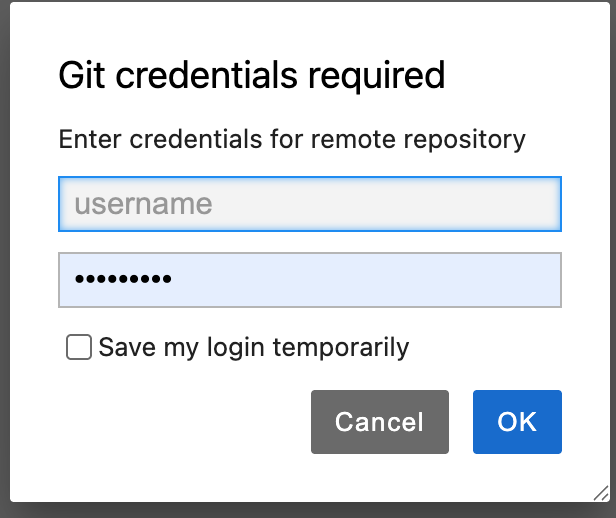

3. 输入用户名(注册用的电话号码)密码

4. 按要求补全 ipynb 文件、撰写实验报告,过程可能持续数小时,期间记得每小时更新 codelab 剩余时间和

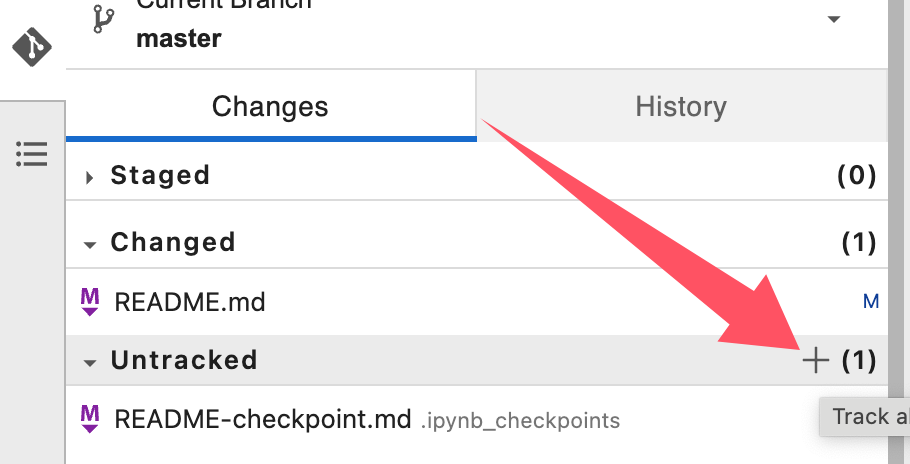

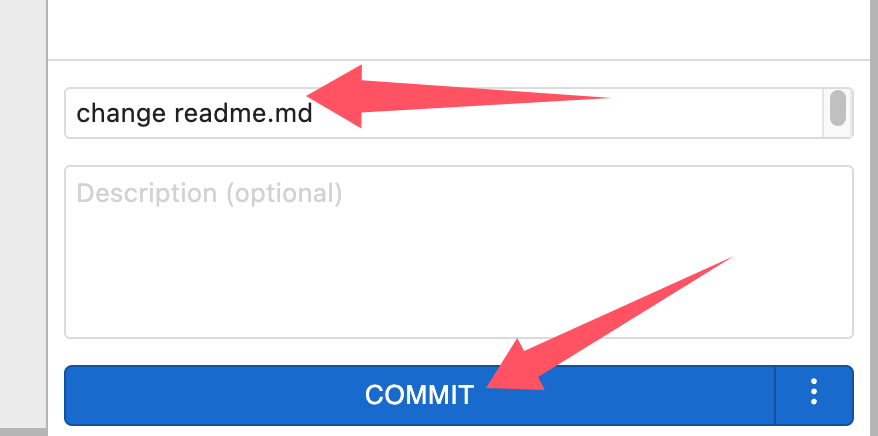

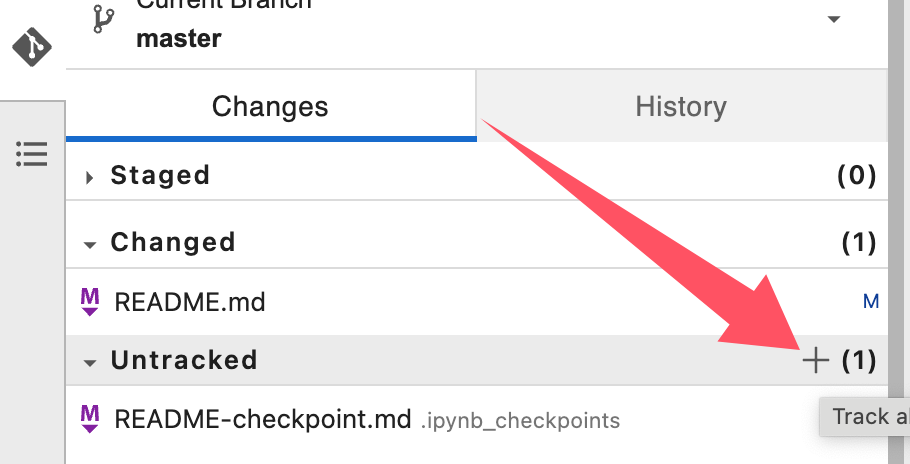

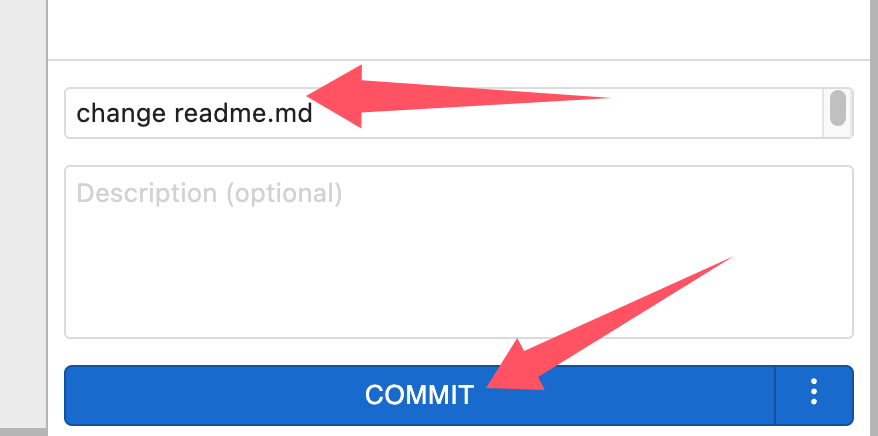

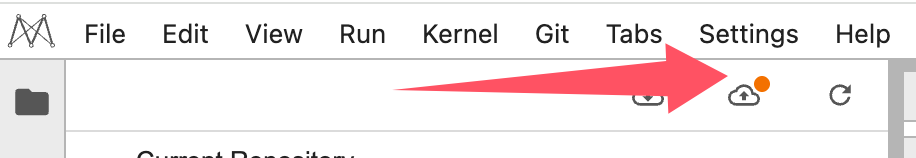

commit 主要工作并将更改 push 到你 fork 的远程仓库(记得选对学号分支)。下图 1track 所有更改 图 2commit 所有更改 图 3push 所有更改

5.

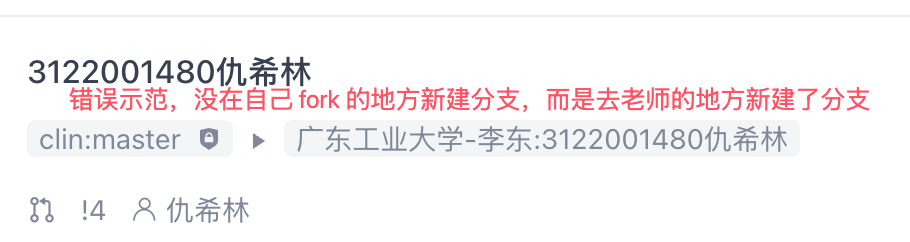

下图红色箭头处写清楚 学号姓名

|

|

| 第16讲 现代循环神经网络 2 |

课前线上资源 词嵌入 课前线上资源 词嵌入 |

|

|

课件16-1 现代循环神经网络 课件16-1 现代循环神经网络 |

|

|

课件16-2 编码器解码器架构 课件16-2 编码器解码器架构 |

|

|

课件 16-3 词嵌入 课件 16-3 词嵌入 |

|

|

图解词嵌入king - man + woman is queen; but why? 图解词嵌入king - man + woman is queen; but why? |

|

|

| 实验3 CNN(test03) |

实验 3 gitee 地址 按实验 2说明 fork 实验 3 gitee 地址 按实验 2说明 fork |

https://gitee.com/gdutcv/mlex03

实验课内完成 所有且通过老师/助教审查问答(每人一次代码重写机会,审查问答改进代码和报告任意次),删除任意 5 行左右代码,60 秒内可以重写,满分 100 分。120 秒内重写,95 分。超过 120 秒,按未能重写计算,88 分。课后 完成所有 85 分。未完成所有项目按比例扣分。 |

|

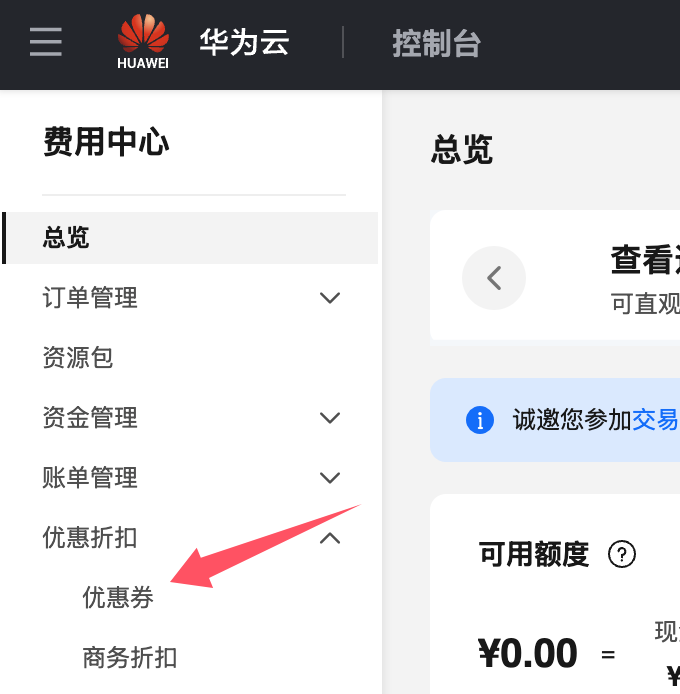

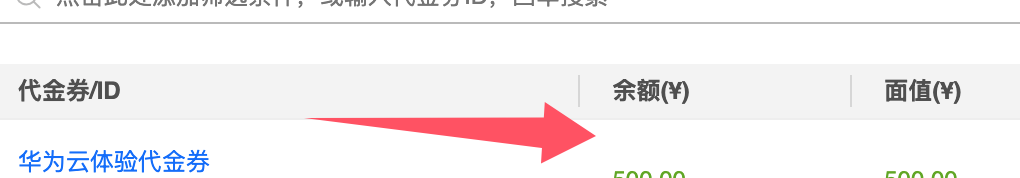

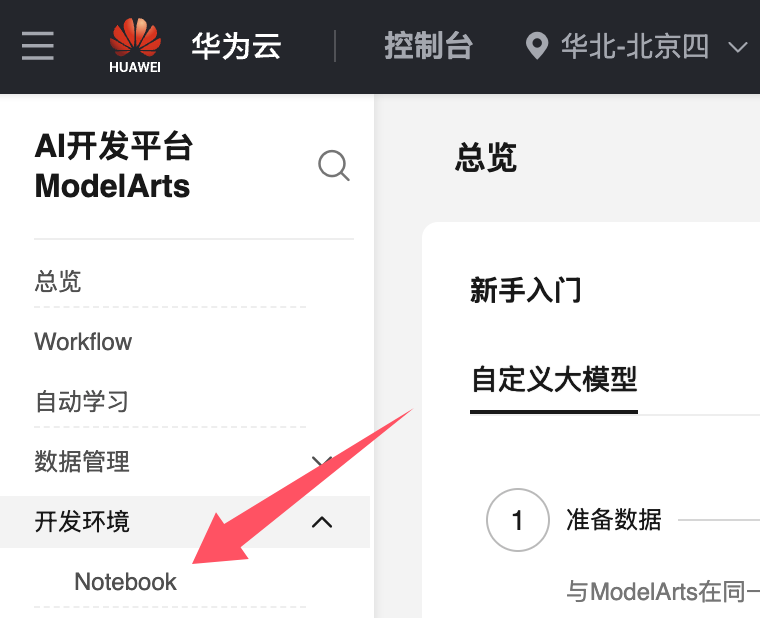

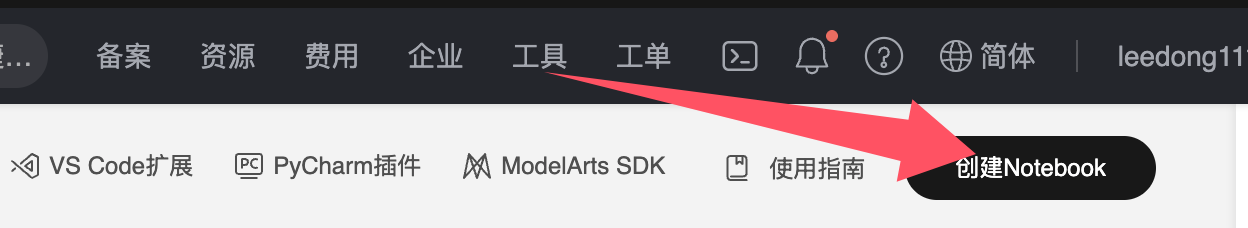

使用 modelarts 付费GPU 资源 notebook 使用 modelarts 付费GPU 资源 notebook |

|

|

准研究生 无模板下载 cifar10 准研究生 无模板下载 cifar10 |

from download import download

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/notebook/datasets/cifar-10-binary.tar.gz"

download(url, "./datasets-cifar10-bin", kind="tar.gz", replace=True) |

|

参考资料 mindspore图像数据加载与增强 参考资料 mindspore图像数据加载与增强 |

|

|

参考资料 sklearn TSNE用法 参考资料 sklearn TSNE用法 |

|

|

| 第17讲 计算机视觉 |

17 目标检测 17 目标检测 |

|

|

| 第18讲 注意力机制 |

课件17-1 注意力机制概述 课件17-1 注意力机制概述 |

|

|

课件17-2 自注意力 课件17-2 自注意力 |

|

|

图解神经机器翻译模型(带有注意力机制的 Seq2seq 模型) 图解神经机器翻译模型(带有注意力机制的 Seq2seq 模型) |

|

|

使用注意力机制的seq2seq【动手学深度学习v2】 使用注意力机制的seq2seq【动手学深度学习v2】 |

|

|

| 第19讲 Transformer |

课件18-1 Transformer概述 课件18-1 Transformer概述 |

|

|

课件18-2 Transformer 课件18-2 Transformer |

|

|

图解Transformer 图解Transformer |

|

|

| 第20讲 自然语言处理:预训练1 |

glove loss 函数推导 glove loss 函数推导 |

|

|

| 第 21讲 自然语言处理:预训练2 |

使用BERT网络实现智能写诗 使用BERT网络实现智能写诗 |

|

|

图解GPT2 图解GPT2 |

|

|

课件20 预训练模型 课件20 预训练模型 |

|

|

预训练 2ppt 预训练 2ppt |

|

|

| 第22讲 无监督学习:降维,深度学习可视化 |

课前线上资源:降维方法小结和理解:PCA、LDA、MDS、ISOMAP、SNE、T-SNE、AutoEncoder 课前线上资源:降维方法小结和理解:PCA、LDA、MDS、ISOMAP、SNE、T-SNE、AutoEncoder |

|

|

课中资源 CNN explainer 课中资源 CNN explainer |

|

|

课中资源 卷积可视化ZFnet 课中资源 卷积可视化ZFnet |

|

|

15-1 课件PCA Kmeans 15-1 课件PCA Kmeans |

|

|

15-2课件 LLE T-SNE 15-2课件 LLE T-SNE |

|